Pont recherche intégré

Aperçu de la réponse cérébrale pour vos pages

Le monde produit parle beaucoup de modèles qui simulent comment le cerveau réagit à ce que nous voyons et entendons. TRIBE v2 de Meta est au centre du débat : un encodeur trimodal qui prédit une activité de type IRMf à partir de vidéo, audio et texte. Motivd propose une entrée concrète pour les fondateurs : comprendre la science, comparer Motivd et les apps livrées aux founders, et brancher un worker d’inférence optionnel depuis Admin → Santé.

Pourquoi ce sujet fait le buzz

Les équipes produit testent déjà pixels et textes en A/B. La prochaine étape est d’anticiper si une interface risque de surcharger l’attention ou de paraître cohérente avant la mise en ligne — surtout pour l’onboarding, les tarifs et les tableaux de bord denses.

TRIBE v2 ne remplace pas la recherche utilisateur. C’est un angle de calcul : un modèle entraîné sur des données IRMf à grande échelle pour raisonner in silico sur les stimuli. Motivd place ce récit à côté de votre builder pour garder les pieds sur terre sur ce qui est réellement utilisable aujourd’hui.

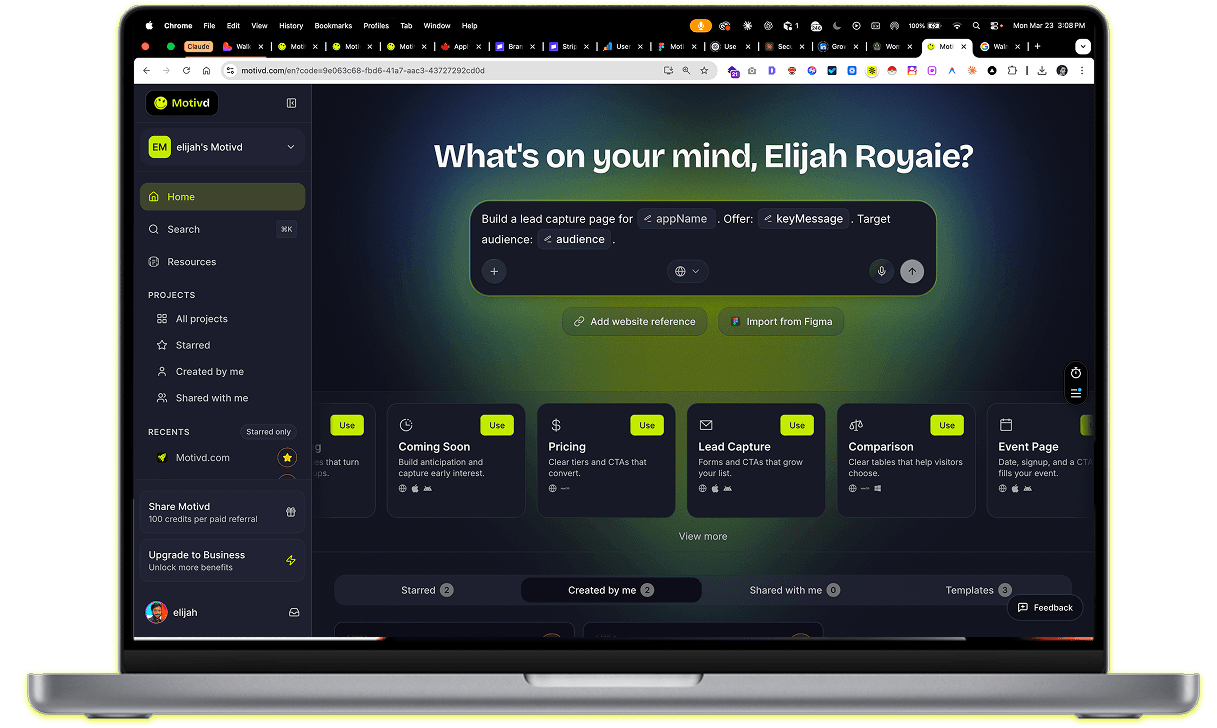

Ce que Motivd apporte

- Une page publique (celle-ci) qui explique le pont en langage clair, avec illustrations Motivd et des liens vers le blog et la démo Meta pour les médias officiels TRIBE v2.

- Admin → Santé : import d’une capture, étiquette Motivd vs app founder, et envoi vers votre worker TRIBE v2 si configuré (voir docs/TRIBE_V2.md).

- Préréglages pour les routes Motivd afin d’aligner les cadres EN/FR et les entonnoirs clés.

- Contexte licence : les poids TRIBE v2 sont en CC BY-NC — soyez prudents sur les messages publics et l’usage en production.

De la capture d’interface à l’insight

Motivd dans la boucle

Votre builder IA et les aperçus device voisinent le récit recherche — la même stack que vous déployez sur Vercel et GitHub.

Récit TRIBE v2 (illustré)

Les images de l’annonce Meta sont sur leur CDN et bloquent souvent l’affichage en hotlink. Nous montrons des illustrations Motivd ici ; ouvrez l’article Meta pour les visuels officiels.

Pour les médias publiés par Meta, utilisez les liens d’annonce et de démo ci-dessus.

Motivd ne fournit pas d’usage clinique ni diagnostique. Les sorties TRIBE v2 sont des simulations de recherche, pas des conseils médicaux.

Questions fréquentes

Construisez ce qui compte

Une vraie codebase, à votre rythme : alignement PRD d’abord, construction dans Motivd Cloud, GitHub quand vous voulez. Discutez avec l’IA — pensé pour les fondateurs.

Comment ça marche

- 1. Décrivez votre idée

Dites-nous ce que vous voulez construire ou déposez des maquettes.

- 2. Cahier des charges puis code

Nous rédigeons un cahier des charges produit (PRD) pour être alignés, puis nous construisons votre app Next.js sur Vercel.

- 3. Déployez

Connectez GitHub quand vous êtes prêt, déployez en un clic et ajoutez votre domaine — ou continuez depuis Motivd Cloud entre-temps.